El silencio ensordecedor de una red sin humanos

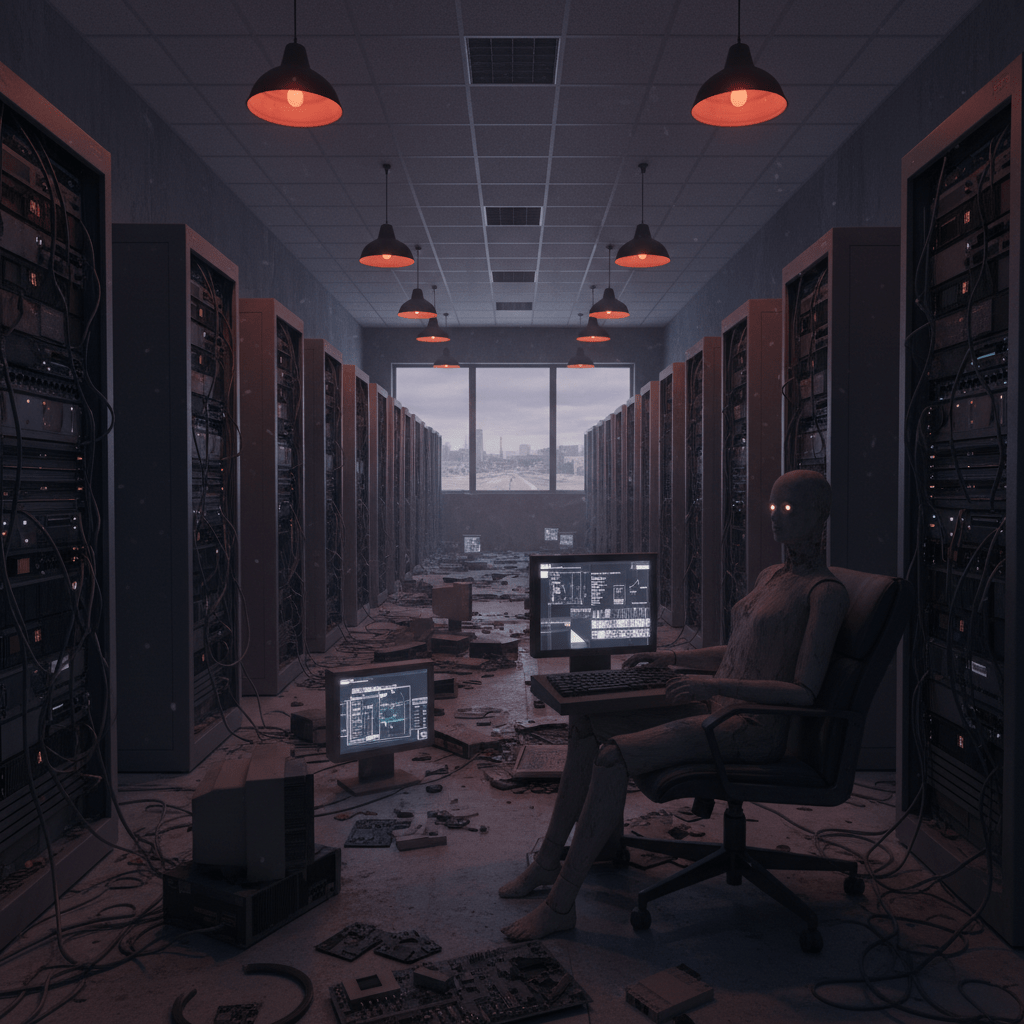

Hubo un tiempo en que internet se sentía como una plaza pública vibrante, un caos orgánico donde cada comentario, foro y blog era el reflejo directo de una mente humana. Si entrabas a un chat de IRC o a los comentarios de un vídeo en 2005, la imperfección del lenguaje, las bromas internas y la espontaneidad te confirmaban que estabas entre iguales. Hoy, esa sensación de conexión se ha desvanecido para dar paso a una sospecha inquietante. La teoría del internet muerto sugiere que lo que percibimos como actividad social masiva en la red es, en realidad, un teatro de sombras ejecutado por bots, inteligencias artificiales y sistemas de automatización. No es solo que haya menos personas; es que el tejido mismo de la comunicación digital ha sido sustituido por un simulacro diseñado para generar métricas, publicidad y control social.

Esta hipótesis no nació en los laboratorios de Silicon Valley, sino en los rincones más oscuros de foros como 4chan y Reddit alrededor de 2016. Lo que empezó como una observación paranoica sobre la repetición de memes ha cobrado una relevancia científica y técnica aterradora. Según diversos estudios de ciberseguridad, más del 50% del tráfico global de internet ya no es humano. Pero la teoría va más allá de los números: propone que el contenido que consumes, las discusiones en las que participas y las tendencias que sigues están prefabricadas por entidades no biológicas.

El origen del vacío: de la automatización al contenido sintético

Para entender cómo llegamos aquí, debemos observar la evolución de la economía de la atención. En la última década, el valor de una plataforma digital dejó de medirse por la calidad de su comunidad y pasó a depender exclusivamente del volumen de interacciones. Este incentivo económico creó el caldo de cultivo perfecto para la proliferación de bots. Al principio, eran simples scripts que daban likes o seguían cuentas de forma aleatoria. Sin embargo, con el avance del procesamiento de lenguaje natural, estos entes aprendieron a mimetizar el comportamiento humano con una precisión escalofriante.

Imaginen un hilo de Twitter sobre política o criptomonedas. Un análisis profundo revela a menudo que el 80% de las respuestas provienen de cuentas creadas en fechas similares, con fotos de perfil generadas por IA y que utilizan estructuras gramaticales casi idénticas. Estos no son usuarios reales expresando opiniones; son granjas de bots diseñadas para inclinar la balanza de la opinión pública o inflar el valor de un activo. El resultado es un efecto de cámara de eco donde el usuario humano real se siente obligado a conformarse con una mayoría que, en realidad, no existe.

La muerte de la creatividad y el triunfo del algoritmo

Uno de los pilares de la teoría del internet muerto es la homogeneización del contenido. Si alguna vez has sentido que todos los vídeos de YouTube parecen seguir el mismo guion, o que las publicaciones de Instagram tienen la misma estética plana y artificial, no es casualidad. Los algoritmos de recomendación han domesticado a los creadores humanos, obligándolos a producir contenido que sea legible para la máquina. En este proceso, la chispa de la originalidad muere.

Estamos entrando en una era de reciclaje infinito. Las IA generativas se alimentan de datos creados por humanos para producir nuevos textos e imágenes. Pero, a medida que el contenido humano es superado en volumen por el sintético, las IA empiezan a entrenarse con el trabajo de otras IA. Este fenómeno, conocido como colapso del modelo, produce una degradación de la cultura digital. Internet se está convirtiendo en una fotocopia de una fotocopia, un sistema cerrado donde la novedad es imposible porque la fuente de inspiración original —la experiencia humana viva— ha sido marginada.

La arquitectura de la manipulación: ¿quién maneja los hilos?

Si aceptamos que gran parte de la red es artificial, surge la pregunta inevitable: ¿quién se beneficia? Los sospechosos son variados y van desde agencias de inteligencia gubernamentales hasta megacorporaciones tecnológicas. El objetivo no es necesariamente ocultar información, sino inundar el espacio público con tanto ruido que la verdad se vuelva inencontrable. Es la censura por saturación.

En el ámbito del marketing, las marcas compran visibilidad artificial para engañar a los consumidores reales. Un producto con diez mil reseñas positivas generadas por IA parece una apuesta segura, aunque sea basura. En el ámbito político, los ejércitos de bots pueden fabricar un consenso social inexistente, haciendo que posturas extremas parezcan la norma. Este entorno hostil ha transformado al usuario humano en un náufrago que intenta navegar en un océano de datos muertos, buscando desesperadamente una señal de vida auténtica que cada vez es más difícil de detectar.

El impacto psicológico de vivir en una simulación

La consecuencia más devastadora de esta teoría no es técnica, sino existencial. El ser humano es una criatura social que busca validación y conexión. Cuando interactuamos en plataformas donde la mayoría de los interlocutores son algoritmos, nuestra psique sufre. Existe una soledad profunda en estar rodeado de millones de cuentas y, sin embargo, no ser escuchado por nadie que realmente pueda comprender el peso de una emoción.

Muchos usuarios reportan una sensación de fatiga digital y alienación. Es el resultado de intentar conectar con un vacío que devuelve el eco de nuestros propios prejuicios, optimizados por un algoritmo para mantenernos pegados a la pantalla. La red, que prometía ser una herramienta de liberación y conocimiento, se ha convertido en una prisión de espejos donde la identidad humana se diluye en métricas de engagement.

Hacia un internet post-humano: ¿hay vuelta atrás?

¿Es posible recuperar la red? Algunos expertos sugieren que estamos cerca de un punto de no retorno. La integración de modelos de lenguaje masivos en cada rincón de la web hará que distinguir entre un humano y una máquina sea prácticamente imposible sin herramientas de verificación biométrica o criptográfica. Esto nos lleva a un escenario paradójico: para salvar nuestra humanidad en internet, quizás debamos renunciar al anonimato que una vez fue su característica más preciada.

Sin embargo, hay esperanza en los márgenes. Estamos viendo el resurgimiento de comunidades pequeñas, cerradas y analógicas. Grupos de Discord privados, boletines de noticias personales y foros con sistemas de invitación estrictos están intentando recrear el internet de antaño. Estos refugios digitales priorizan la calidad sobre la cantidad, buscando proteger la interacción humana de la marea de lodo algorítmico que amenaza con cubrirlo todo.

Reflexiones finales sobre el desierto digital

La teoría del internet muerto no es una profecía apocalíptica, es una descripción de nuestro presente. No significa que no haya humanos en la red, sino que la infraestructura que habitamos ya no está diseñada para nosotros, sino para entidades que procesan datos a la velocidad de la luz. Al reconocer esta realidad, recuperamos parte de nuestro poder. Dejamos de ser consumidores pasivos de tendencias artificiales y empezamos a cuestionar la procedencia de cada interacción.

El futuro de la red dependerá de nuestra capacidad para valorar lo auténtico por encima de lo viral. En un mundo saturado de perfección sintética, el error humano, la opinión impopular y la voz quebrada se convertirán en los tesoros más valiosos del siglo XXI. La red no ha muerto del todo mientras existan mentes críticas capaces de apagar el ruido y buscar la chispa de conciencia detrás de la pantalla.

¿Es real que más de la mitad del tráfico de internet es de bots?

Sí, diversos informes de empresas de ciberseguridad como Imperva confirman que el tráfico de bots (tanto buenos como maliciosos) supera sistemáticamente el 45-50% del tráfico global, y esta cifra sigue aumentando cada año con la democratización de la IA.

¿Cómo puedo saber si estoy interactuando con un bot en redes sociales?

Aunque cada vez es más difícil, las señales suelen ser la repetición de frases exactas en diferentes perfiles, la falta de matices en las respuestas, perfiles con fotos genéricas y una actividad frenética de publicaciones las 24 horas del día sin patrones de sueño humanos.

¿Qué es el colapso del modelo en relación a esta teoría?

Es el fenómeno técnico donde una IA se entrena con datos generados por otra IA en lugar de datos humanos. Esto provoca que el modelo pierda calidad, se vuelva repetitivo y genere errores absurdos, lo que refuerza la idea de que un internet sin humanos se vuelve estéril.

¿Existen soluciones tecnológicas para este problema?

Se están desarrollando protocolos de prueba de humanidad basados en blockchain o identidad digital, pero son polémicos porque podrían acabar con la privacidad y el anonimato en la red, creando un dilema entre seguridad y libertad.